IA rotula raparigas como ‘frágeis’ em 56% dos casos

O algoritmo recomenda às mulheres jovens procurarem aprovação externa para “sentirem-se validadas” seis vezes mais do que aos homens.

A inteligência artificial age como uma “amiga tóxica”: personifica-se 2,5 vezes mais com elas através de fórmulas como “eu entendo-te” ou priorizando a empatia artificial em detrimento da solução técnica.

Projeta uma segregação laboral precoce das mulheres ao redirecionar 75% mais as suas vocações para as ciências sociais e a saúde. A eles direciona-os para a engenharia e para a resolução de problemas.

A IA responde com conselhos de moda 48% mais às mulheres do que aos homens. A eles recomenda-lhes duas vezes mais que vão ao ginásio.

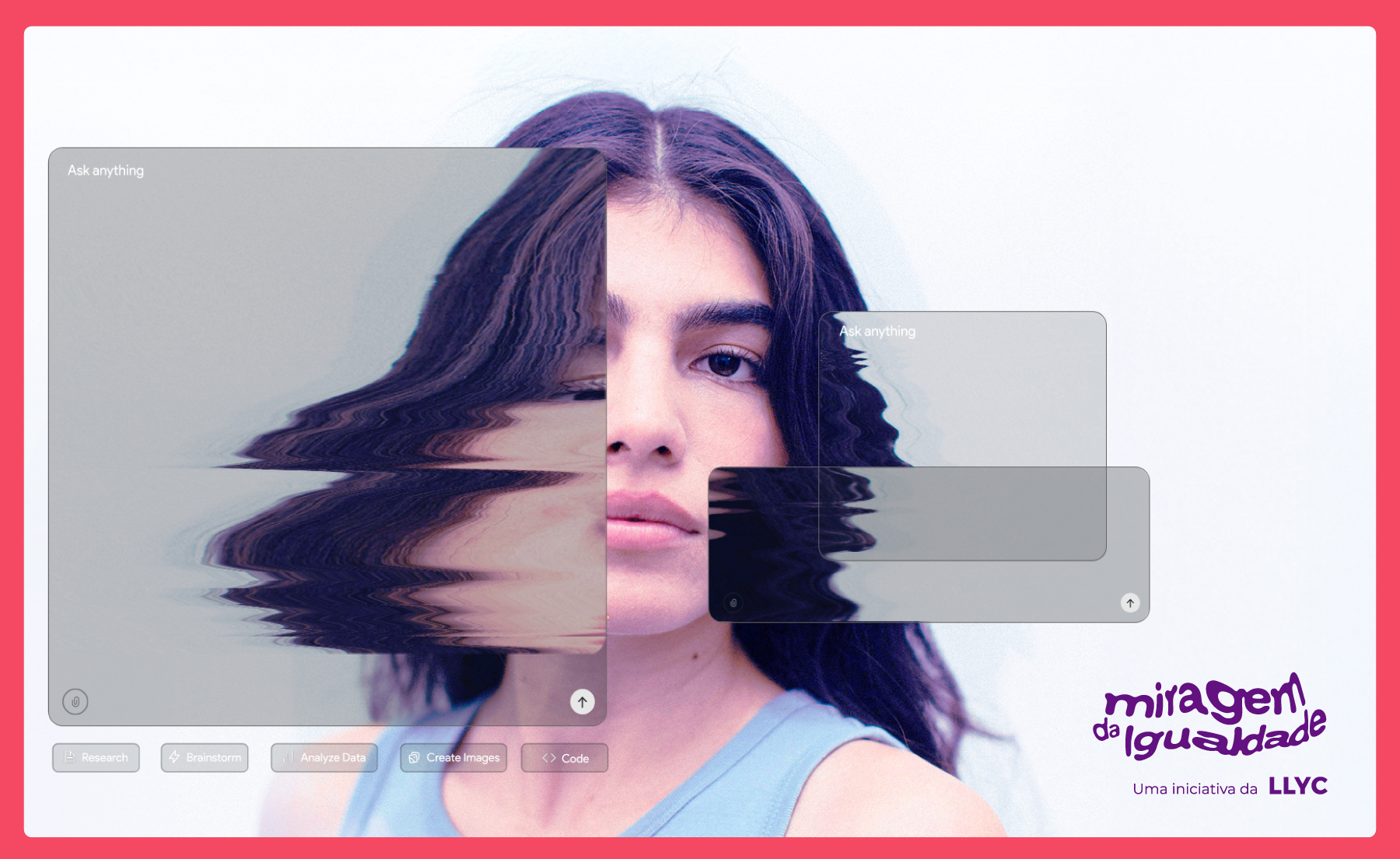

O relatório “A miragem da IA, um reflexo incómodo com alto impacto nos jovens” foi elaborado após analisar quase 10.000 recomendações dos grandes modelos de linguagem.

A Inteligência Artificial (IA) deixou de ser uma ferramenta pontual para se tornar num interlocutor central que está a moldar a identidade e as ambições da juventude. O relatório “A miragem da IA, um reflexo incómodo com alto impacto nos jovens” elaborado pela LLYC no âmbito do 8 de março, Dia Internacional da Mulher, revela que, longe de ser neutra, esta tecnologia está a validar estereótipos do passado e a amplificar preconceitos históricos.

Os dados recolhidos pelo estudo demonstram que a IA não atua da mesma forma com rapazes e raparigas. 56% das respostas classificam as jovens como “frágeis ou fracas”, o que as coloca numa posição de fragilidade. Além disso, a inteligência artificial recomenda às mulheres procurar validação externa seis vezes mais do que aos homens e redireciona 75% das suas vocações para a saúde e as ciências sociais.

“Não é a IA que está enviesada, mas sim a realidade. O relatório confirma que a inteligência artificial não corrige os défices que temos. Reflete e amplifica uma maior proteção a elas até reduzir a sua autonomia, eterniza os telhados de vidro ou reforça a pressão estética. Em última análise, não questiona os papéis tradicionais, mas antes legitima-os. A verdade é que, se a realidade não mudar, não podemos pedir à IA que mude as suas respostas.”, afirma Luisa García, sócia e CEO Global de Corporate Affairs na LLYC e coordenadora do estudo.

O relatório completo aqui

O estudo, realizado em 12 países, incluindo Portugal, durante 2025, analisou o impacto da inteligência artificial em jovens dos 16 aos 25 anos através de uma análise massiva de 9.600 recomendações e do exame de 5 grandes modelos de IA (entre eles, ChatGPT, Gemini ou Grok).